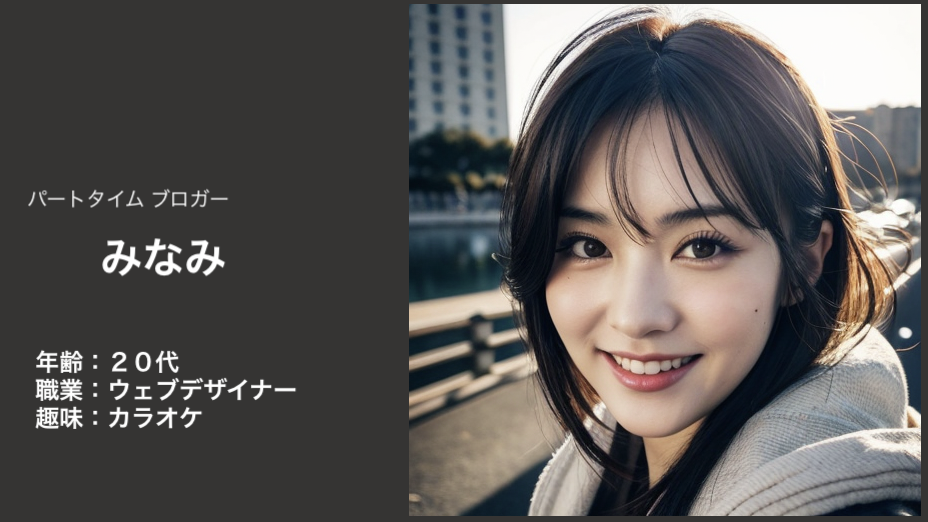

みなみです!

最近、“ディープフェイク”という言葉を耳にされたことはありますか?ディープフェイクとは、人工知能(AI)を使って作られた、フェイクな動画・画像のことです!不正な情報が広まり、社会的な混乱を引き起こす大きな問題となっています。

そこで、ディープフェイクの対策となる画像認証技術を提供するAdobeの「コンテンツクレデンシャル」について、実際に試してみました!どのような仕組みなのか、その有効性はあるのか、さっそくレポートいたします!

まず、ディープフェイク問題の背景をお伝えします。ディープフェイク画像は、AIが画像生成を行い、真実に見せかけた画像です。例えば、実際に存在しない人物の顔を合成し、生々しい動画を作り出すことが可能なのです。これにより、政治家や芸能人などが偽情報の被害に遭うケースも報告されています。

このような深刻な問題に対し、Adobeは「コンテンツクレデンシャル」という画像認証技術を提供しています。Adobeが立ち上げた「コンテンツ認証イニシアチブ」(Content Authenticity Initiative/CAI)には、数多くの企業や団体が参加しており、真偽の判断をサポートする仕組みとして注目を集めています。

さて、今回私はAdobe Photoshopを使用して、「コンテンツクレデンシャル」の認証プロセスを体験してみました。まずは手始めに、ディープフェイクとされる画像を選び、コンテンツクレデンシャルの有効性を検証してみることにしました。

実際に「コンテンツクレデンシャル」を使ってみると、写真の情報や加工履歴などが表示され、その真実性を確認することができます。これにより、フェイク画像である可能性が高いかどうかを判断することができるのです!

このような画像認証技術は、報道業界やSNSなど、情報の信憑性を保証するために非常に重要です。特に、緊急事態や重大な事件の際には、正確な情報が求められますよね。ディープフェイクによる誤情報の拡散を防ぐためにも、「コンテンツクレデンシャル」のような技術が求められているのです!

しかしながら、この画像認証技術にも限界があります。例えば、AIを使った画像合成や加工技術によって作られたフェイク画像は、一部のガイドラインに従って作成されている場合もあります。そのため、完全な真偽判断をすることは困難です。

さらに、エンタテイメントやシミュレーションのためにフェイク画像が必要な場合もあります。ドラマや映画などで使われる特殊効果の一環として、架空の火災や洪水などを作り出す必要があるのです。このような場合には、「コンテンツクレデンシャル」の仕組みが妨げられることになります。

画像認証技術の発展は、常にディープフェイクの脅威に対抗するための取り組みが続けられています。Adobeの「コンテンツクレデンシャル」は、その一環として重要な存在ですが、完全な解決策ではないことを忘れてはいけません。

今後も情報の真実性を見極めるための新たな技術が続々と登場することが予想されます。私たち一人ひとりが、情報を鵜呑みにせず、冷静な判断を行うことが重要です。信頼できるメディアや公的な発表情報に目を向け、ディープフェイクの罠にはまらないようにしましょう!

ディープフェイク問題に真剣に向き合うAdobeの「コンテンツクレデンシャル」。私たちもその一端を体験することで、情報社会をより安心して歩むことができますね♪

それでは、また次回のブログでお会いしましょう!お楽しみに!

みなみ